Scaling Law被证伪,谷歌研究人员实锤研究力挺小模型更高效,不局限于特定采样技术!

发布于2024-12-28 阅读(0)

发布于2024-12-28 阅读(0)

扫一扫,手机访问

出品 | 51CTO技术栈(微信号:blog51cto)

“模型越大,效果越好”,Scaling Law再次被OpenAI带火了,但谷歌的研究人员的最新研究证伪了这一观点。

在周一发表的一项研究中,谷歌研究院和约翰霍普金斯大学的研究人员对人工智能(AI)模型在图像生成任务中的效率进行了新的认识。这些发现挑战了“越大越好”的普遍信念,可能对开发更高效的人工智能系统产生重大影响。 在这项研究中,研究人员对比了不同规模的AI模型在生成图像任务中的表现。他们发现,尽管更大的模型通常会产生更高质量的图像,但效率并不一定更高。相反,较小的模型在相同时间内可以生成更多的图像,而且质量也不差。 这一发现有助于我们更好地理

1.模型大小与性能之间的较量

该研究由研究人员Kangfu Mei和Zhengzhong Tu共同主导,重点关注潜在于扩散模型(LDM)的缩放特性及其采样效率。LDM是一种人工智能模型,用于根据文本描述生成高质量图像。

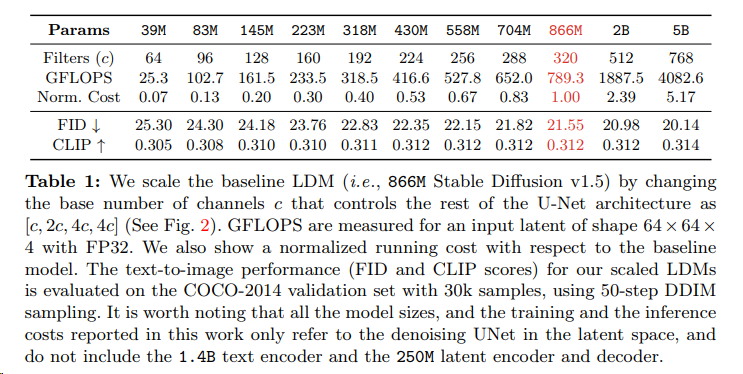

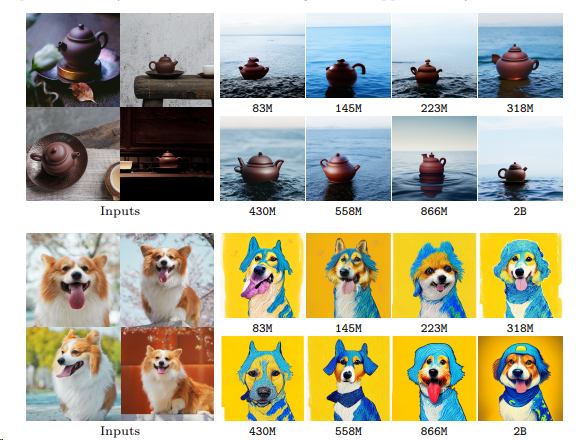

为了研究模型大小和性能之间的关系,研究人员训练了一套12个文本到图像LDM模型。其参数数量从3900万到惊人的50亿不等。然后,这些模型在各种任务上进行了评估,包括将文本转化为图像的生成、超分辨率和主题驱动的生成等。这些评估结果表明,模型大小和性能之间存在一定的关联。

在论文中写到,“虽然改进的网络架构和推理算法已被证明可以有效提高扩散模型的采样效率,但模型大小(采样效率的关键决定因素)的作用尚未得到彻底检验。”

图片

图片

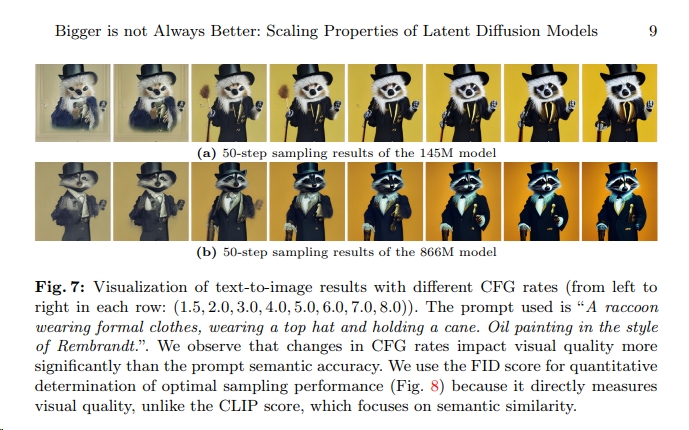

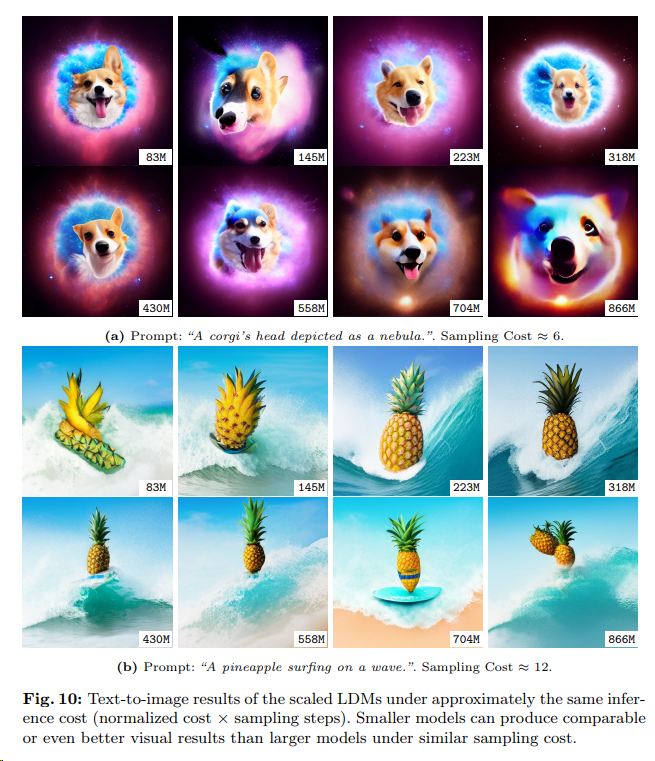

研究表明,确定推理预算(相同的假设成本)下进行计算时,精简的模型可以胜过较大的模型。换句话说,在计算资源有限时,更简洁的模型可能比更复杂、需要更多资源的模型产生更高质量的图像。这为在模型规模上加入LDMs提供了一个有前景的方向。

图片

图片

研究人员在论文中进一步表明,采样效率在多个维度上是一致的。研究人员有一个重要发现,较小模型的采样效率在各种扩散采样器(随机和确定性)中都是保持一致的,甚至在蒸馏模型(原始模型的压缩版本)中也是如此。这表明较小模型的优势并不限于特定的采样技术或模型压缩方法。

研究者认为,这种对缩放采样效率的分析将对指导LDMs的未来发展起到关键作用,特别是在广泛的实际应用中平衡模型规模与性能和效率方面。

图片

图片

图片

图片

然而,该研究还指出,当计算约束放松时,较大的模型仍然擅长生成细粒度的细节。这表明虽然较小的模型可能更有效,但在某些情况下仍然需要使用较大的模型。

2.写在最后

这项研究的影响是深远的,因为它为开发更高效的图像生成人工智能系统开辟了新的可能性。通过了解 LDM 的扩展特性以及模型大小和性能之间的权衡,研究人员和开发人员可以创建在效率和质量之间取得平衡的 AI 模型。

这些发现符合人工智能社区的最新趋势,即 LLaMa 和 Falcon 等小型语言模型在各种任务中的表现都优于大型语言模型。推动构建开源、更小、更高效的模型的目的是使人工智能领域民主化,让开发人员能够构建自己的人工智能系统,这些系统可以在单个设备上运行,而不需要大量的计算资源。

不得不说,在 GenAI 领域,有那么一点“大行不顾细谨,大礼不辞小让”的感觉。

参考链接:https://arxiv.org/pdf/2404.01367.pdf

想了解更多AIGC的内容,请访问:

51CTO AI.x社区

https://www.51cto.com/aigc/

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- 现货不行冲期货!Proshares再申请二档杠杆以太坊ETF

- 自一月SEC批准比特币现货ETF以来,加密社群热烈期待以太坊现货ETF,但近期在SEC不断延后的情况下,大家对五月批准的机率也不再乐观。与此同时,擅长以期货和杠杆操作的ETF发行商Proshares,提交了2倍正反向以太坊期货ETF,试图吸引投资者的目光。以太坊期货ETF上市情况美国证券交易委员会(SEC)在2023年10月批准9档以太坊相关期货ETF,其中Proshares的以太坊策略ETF(EETH)也在其中,它是以投资芝商所以太坊期货(CMEETHERFUTURE)来获得以太币相关曝险,不过上市之后

- 10分钟前 以太坊价格 以太坊养猫 以太坊钱包 比特币期货 比特币杠杆 0

-

正版软件

正版软件

- Oak Grove Crypto 2024 圆满落幕,吸引全球数千名 Web3 建设者公议未来五年新趋势

- 4月5日,在香港区块链期间,由OakGroveVentures主办、Polyhedra、AlchemyPay、Ritual和ChainCatcher联办的OakGroveCrypto2024圆满落幕。活动现场,Binance、CoinMarketCap、TRON、SolanaFoundation、NEARProtocol、Gate.io、OKXWallet、BitgetWallet、MantaNetwork、io.net、MerlinChain、Lifeform、Delysium、IoTeX、Bounce

- 15分钟前 0

-

正版软件

正版软件

- 摩托罗拉Edge 50 Ultra配备1.5K OLED屏和125W快充

- 4月13日消息,近日知名博主@数码闲聊站曝光了摩托罗拉即将发布的新款手机——Edge50Ultra。该机规格详细参数,预计将配备顶级的骁龙8SGen3处理器,展现出强大的性能。摩托罗拉Edge50Ultra在设计上采用了金属框与玻璃机身的组合,不仅保证了手机的坚固耐用,还赋予了其高质感的外观。屏幕方面,该机将搭载一块1.5K分辨率、144Hz刷新率的OLED屏幕,为用户带来极致的视觉体验。此外,手机还配备了12GB的RAM,确保流畅的多任务处理能力。这样的配置,使得摩托罗拉Edge50Ultra成为了一款

- 30分钟前 0

-

正版软件

正版软件

- AI热潮下,公链基础设施赛道都有哪些变化?

- 最近在一级市场,最火热的赛道无疑是AI,其次是BTC,每天聊的项目80%都集中在这两个赛道,我个人最多的时候一天可以聊5,6个AI项目。可以预见的是AI泡沫会在明后年达到顶峰,随着数以百计的AI新项目上线,AI赛道市值攀向巅峰,在最终泡沫破裂,一地鸡毛的同时,也会诞生出真正找到AIXCrypto契合点的独角兽,把这个赛道以及整个行业继续向前推进。所以在当前AI过热的环境下,静下心来,看看近几个月在Infra层面,尤其是公链Infra这个赛道发生了哪些变化,其中有些新的东西还是值得一说.。一.ETH,或者说

- 45分钟前 0

-

正版软件

正版软件

- 2024年4月数字货币未来趋势如何?四月虚拟货币行情预测

- 2024年4月数字货币是什么样的?币圈预测四月份回事暴涨行情吗?今天给大家分享一些个人的投资心得(CEX限定),和对部分热门币种与叙事的分析,含Eigenlayer叙事、BTC生态、并行EVM叙事。四月是比特币减半的月份,许多机构和数字货币圈都对四月的数字资产市场持乐观态度。今天小编将分享一篇可靠的四月市场分析文章给大家。TL;DREigenlayer叙事、BTC生态、并行EVM叙事;币种$PENDLE$CKB$CANTO$SEI;1/个人投资心得方面晚上梳理了下仓位,个人认为是有必要缩减仓位到10个以内

- 55分钟前 虚拟货币 数字货币 趋势 行情 0