深入解析Java爬虫技术:网页数据抓取的实现原理

发布于2024-10-28 阅读(0)

发布于2024-10-28 阅读(0)

扫一扫,手机访问

深入解析Java爬虫技术:网页数据抓取的实现原理

引言:

随着互联网的快速发展和信息爆炸式增长,大量的数据被存储在各种网页上。这些网页数据对于我们进行信息提取、数据分析和业务发展非常重要。而Java爬虫技术则是一种常用的网页数据抓取方式。本文将深入解析Java爬虫技术的实现原理,并提供具体的代码示例。

一、什么是爬虫技术

爬虫技术(Web Crawling)又称为网络蜘蛛、网络机器人,是模拟人的行为,自动地浏览互联网并抓取信息的一种技术。通过爬虫技术,我们可以自动化地抓取网页上的数据,并进行进一步的分析和处理。

二、Java爬虫技术的实现原理

Java爬虫技术的实现原理主要包括以下几个方面:

- 网页请求

Java爬虫首先需要发送网络请求获取网页数据。可以使用Java的网络编程工具库(如HttpURLConnection、HttpClient等)发送GET或POST请求,并获取服务器响应的HTML数据。 - 网页解析

获取到网页数据后,需要对网页进行解析,并提取出需要的数据。Java提供了许多网页解析工具库(如Jsoup、HtmlUnit等),可以帮助我们从HTML中提取出文本、链接、图片等相关数据。 - 数据存储

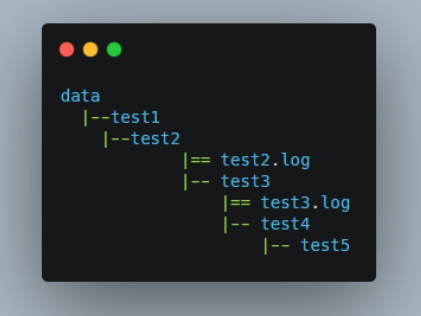

抓取到的数据需要存储到数据库或者文件中,以便后续的处理和分析。可以使用Java的数据库操作工具库(如JDBC、Hibernate等)将数据存储到数据库中,或者使用IO操作将数据存储到文件中。 - 反爬虫策略

为了防止爬虫对服务器造成过大的压力或者对数据的隐私安全造成威胁,许多网站会采取反爬虫策略。爬虫需要在一定程度上绕过这些反爬虫策略,防止被屏蔽或者封禁。可以通过一些技术手段(如使用代理IP、随机User-Agent等)规避反爬虫策略。

三、Java爬虫技术的代码示例

下面是一个简单的Java爬虫代码示例,用于实现从指定网页上抓取图片链接并下载图片。

import org.jsoup.Jsoup;

import org.jsoup.nodes.Document;

import org.jsoup.nodes.Element;

import org.jsoup.select.Elements;

import java.io.BufferedInputStream;

import java.io.BufferedOutputStream;

import java.io.FileOutputStream;

import java.io.IOException;

import java.net.URL;

public class ImageCrawler {

public static void main(String[] args) {

try {

// 发送网络请求获取网页数据

Document doc = Jsoup.connect("https://www.example.com").get();

// 解析网页,提取图片链接

Elements elements = doc.select("img");

// 下载图片

for (Element element : elements) {

String imgUrl = element.absUrl("src");

downloadImage(imgUrl);

}

} catch (IOException e) {

e.printStackTrace();

}

}

// 下载图片到本地

private static void downloadImage(String imgUrl) {

try (BufferedInputStream in = new BufferedInputStream(new URL(imgUrl).openStream());

BufferedOutputStream out = new BufferedOutputStream(new FileOutputStream("image.jpg"))) {

byte[] buf = new byte[1024];

int n;

while (-1 != (n = in.read(buf))) {

out.write(buf, 0, n);

}

} catch (IOException e) {

e.printStackTrace();

}

}

}以上代码中,我们使用了Jsoup库来进行网页解析,通过select方法选择图片标签,并获取图片链接。然后通过URL类来下载图片到本地文件。

结语:

Java爬虫技术是一种强大的工具,可以帮助我们自动化地抓取网页数据,并为我们的业务提供更多的数据资源。通过深入了解Java爬虫技术的实现原理,并运用具体的代码示例,我们可以更好地利用爬虫技术来完成一系列的数据处理任务。同时,我们也需要注意遵守法律和道德规范,在使用爬虫技术时避免侵犯他人的权益。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- 解密PHP Memcached扩展:提升网站性能的使用技巧

- PHPMemcached扩展是一个php扩展,它允许您使用Memcached服务器来存储和检索数据。Memcached是一种内存中的键值存储系统,它可以显著提高网站的性能。要使用PHPMemcached扩展,您需要先安装它。您可以在PHP的官方网站上找到Memcached扩展的安装说明。安装Memcached扩展后,您就可以开始使用它了。您需要创建一个Memcached客户端对象,并连接到Memcached服务器。以下是创建一个Memcached客户端对象并连接到Memcached服务器的示例代码:$me

- 8分钟前 0

-

正版软件

- 指导如何在PyCharm中设置Git

- PyCharm是一款功能强大的集成开发环境(IDE),提供了丰富的工具和功能,方便开发者进行代码编写、调试和版本控制等操作。Git是一种流行的分布式版本控制系统,可以帮助开发团队更好地管理代码,协作开发。在PyCharm中配置Git可以帮助开发者更方便地管理代码仓库、提交和拉取代码变更、处理合并冲突等操作。本文将为大家介绍在PyCharm中配置Git的实用指

- 18分钟前 Pycharm 配置 git 0

-

正版软件

- 展示示例:Golang接口的实用技巧

- Golang中接口的使用技巧Golang(又称Go语言)作为一门快速、简单、高效的编程语言,其接口机制是其特色之一。接口是一种抽象的类型,在Golang中广泛使用,可以提高代码的灵活性和可维护性。本文将通过实例演示Golang中接口的使用技巧,帮助读者更好地理解和运用接口。一、接口的基本概念在Golang中,接口是一组方法的集合,可以以接口类型的形式定义一组

- 33分钟前 接口 技巧 Golang 0

-

正版软件

正版软件

- PHP 自动加载全面总结:掌握要点,提升编程效率

- 1.自动加载的基本原理自动加载机制允许您在需要的时候加载类,而不是在脚本一开始就加载所有的类。这可以显著地提高应用程序的性能,特别是对于那些具有大量类的应用程序。自动加载机制是通过一个称为“自动加载器”的函数来实现的。自动加载器是一个能够将类名映射到文件路径的函数。当您尝试使用一个尚未加载的类时,自动加载器就会被调用,它会将该类的类名映射到一个文件路径,然后加载该文件。2.使用自动加载在PHP中,可以使用多种不同的方法来实现自动加载。最常用的方法是使用Composer。Composer是一个流行的依赖项管

- 48分钟前 PHP Composer 自动加载 0

-

正版软件

- 详细解析如何使用Golang实现文件监控功能

- 使用Golang实现文件监控功能的方法详解随着软件开发的日益普及,文件监控功能在很多应用中变得越来越重要。无论是监视配置文件的更改、日志文件的更新,还是监控文件夹中新文件的添加,都是文件监控功能的常见应用场景。在本文中,我们将详细介绍如何使用Golang实现文件监控功能,并提供具体代码示例。要实现文件监控功能,我们首先需要使用Golang的文件监控包fsno

- 1小时前 20:30 监控文件变化 Golang实现 文件监听 0

最新发布

-

1

1

-

2

2

-

3

- Vue组件中如何处理图片预览和缩放问题

- 431天前

-

4

4

-

5

5

-

6

6

- Python实战教程:批量转换多种音乐格式

- 602天前

-

7

- WebSocket协议的优势与劣势分析

- 432天前

-

8

- java动态代理实例代码分析

- 602天前

-

9

9

- java io文件操作删除文件或文件夹的方法

- 600天前

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00