Java爬虫教程:从初学到专家级网页数据抓取

发布于2024-10-30 阅读(0)

发布于2024-10-30 阅读(0)

扫一扫,手机访问

从入门到精通:Java爬虫教程之网页数据抓取

导言:

随着互联网的快速发展,大量有价值的数据散落在网页上,这些数据包含了丰富的信息,对于开发者和数据分析师来说是非常宝贵的资源。而爬虫作为一种自动化工具,可以帮助我们从网页上获取数据,因此在数据处理和分析过程中被广泛使用。本教程将通过具体的代码示例,带领读者从入门到精通,实现网页数据的抓取。

一、环境准备

首先,我们需要准备好Java开发环境,包括JDK和开发工具(如Eclipse、IntelliJ IDEA等)。另外,我们还需要引入Jsoup这个Java库,它是一款非常强大的HTML解析器,可以帮助我们快速解析网页上的DOM结构。

二、创建项目

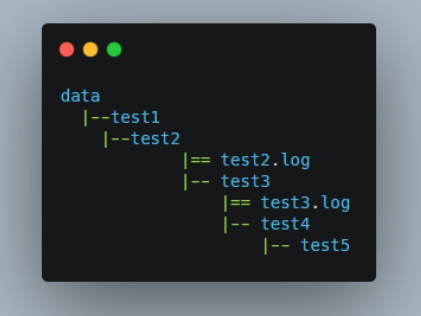

在开发工具中创建一个新的Java项目,命名为"WebCrawler"。接下来,我们需要添加Jsoup库到项目中。可以通过在项目的lib目录下添加Jsoup的jar文件,也可以使用架构管理工具(如Maven)来引入。

三、编写代码

导入所需的包和类:

import org.jsoup.Jsoup; import org.jsoup.nodes.Document; import org.jsoup.nodes.Element; import org.jsoup.select.Elements; import java.io.IOException;

创建一个名为"WebCrawler"的类,并在其中定义一个名为"crawWebData"的方法,用于抓取网页数据:

public class WebCrawler { public static void crawlWebData() { String url = "http://example.com"; // 要抓取的网页URL try { Document doc = Jsoup.connect(url).get(); // 使用Jsoup连接并获取网页文档 // 解析网页上的DOM结构,提取需要的数据 // ... } catch (IOException e) { e.printStackTrace(); } } }- 在"crawWebData"方法中,我们首先使用Jsoup的

connect()方法连接到指定的网页,并使用get()方法获取网页的文档对象。 接下来,我们可以利用Jsoup提供的强大的选择器功能,通过类名、标签名等对DOM结构进行解析和查询,定位到我们需要抓取的数据的位置,如:

// 获取网页中的所有标题 Elements titles = doc.select("h1"); for (Element title : titles) { System.out.println(title.text()); }类似地,我们还可以使用选择器来获取网页中的其他元素,如链接、图片等:

// 获取所有链接 Elements links = doc.select("a[href]"); for (Element link : links) { System.out.println(link.attr("href")); } // 获取所有图片URL Elements images = doc.select("img[src]"); for (Element image : images) { System.out.println(image.attr("src")); }

四、运行程序

在main方法中,实例化WebCrawler类,并调用crawlWebData方法,即可运行爬虫程序,获取网页数据。

public static void main(String[] args) {

WebCrawler crawler = new WebCrawler();

crawler.crawlWebData();

}总结:

通过本教程,我们初步了解了如何使用Java编写一个简单的网页数据抓取程序。当然,爬虫的功能远不止这些,还可以进一步优化和扩展。同时,作为一个负责任的开发者,我们也要遵守网站的规则,合法抓取数据,避免对网站造成负面影响。希望本教程对你有所帮助,祝您愉快的爬虫之旅!

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

- 如何在PHP中处理MySQL中的零值以确保安全性?

- PHP中如何安全地处理MySQL中的0值?在PHP开发中,经常会涉及到与MySQL数据库进行交互并处理各种数据。在处理数据库中的0值时,我们需要注意一些安全性的问题,以避免出现意外的情况。本文将介绍如何安全地处理MySQL中的0值,并提供具体的代码示例。首先,我们需要明确在MySQL中0值可能出现的情况:数据库字段定义为整型,并且允许为0值。查询数据库时,返

- 7分钟前 MySQL PHP 安全处理 0

-

正版软件

- 提升效率:Golang请求处理的方法

- 优化性能:Golang请求处理技巧随着互联网应用的流行,对于网站和服务端性能的要求也越来越高。在处理大量请求时,如何优化Go语言的性能成为了一个重要的问题。本文将介绍一些提高Golang请求处理性能的技巧,并通过具体的代码示例来演示。1.使用并发处理Go语言天生支持并发,可以通过goroutine和channel来实现并发处理请求。在处理多个请求时,可以将

- 17分钟前 并发控制 异步处理 缓存利用 0

-

正版软件

- 解决Ubuntu中PHP无法启动的方法

- 《解决Ubuntu系统中PHP无法启动的问题》在使用Ubuntu系统时,PHP作为一种常见的服务器端脚本语言,常常用于开发网站和Web应用程序。然而,有时候我们可能会遇到PHP无法启动的情况,这可能会给我们的工作和开发造成困扰。本文将介绍一些常见的问题以及解决方法,并提供具体的代码示例来帮助您解决Ubuntu系统中PHP无法启动的问题。问题描述在使用Ubun

- 27分钟前 PHP启动问题 编程错误排除 0

-

正版软件

- 分享提高Golang开发效率的异步编程技巧

- 标题:提升Golang开发效率:异步编程技巧分享随着互联网技术的不断发展,对于高效的并发编程需求也越来越强烈。在Golang这门现代化的编程语言中,异步编程是提高开发效率的重要手段之一。通过合理利用Golang的并发特性,可以更好地实现异步编程,提升程序的并发处理能力。本文将分享一些在Golang中实现异步编程的技巧,带有具体的代码示例,帮助开发者更好地理解

- 42分钟前 并发编程 异步编程 Golang效率 0

-

正版软件

- 深入探讨:golang系统的优缺点

- 标题:深度分析:Golang系统的优势与劣势,需要具体代码示例Golang,又称Go语言,是一种由Google开发的编程语言,自2009年发布以来,逐渐成为许多开发者喜爱的选择。本文将深度分析Golang系统的优势与劣势,并通过具体的代码示例来展示其特点。优势1.并发处理能力强Golang内置了goroutine和channel这两个特性,使得并发编程变得

- 57分钟前 Golang 优势 劣势 0

最新发布

-

1

1

-

2

2

-

3

- Vue组件中如何处理图片预览和缩放问题

- 447天前

-

4

4

-

5

5

-

6

6

- Python实战教程:批量转换多种音乐格式

- 618天前

-

7

- WebSocket协议的优势与劣势分析

- 448天前

-

8

- java动态代理实例代码分析

- 618天前

-

9

9

- java io文件操作删除文件或文件夹的方法

- 615天前

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00