大模型Meta通过自我奖励和迭代战胜GPT-4,证明了LLM终局是由合成数据构成的

发布于2024-11-13 阅读(0)

发布于2024-11-13 阅读(0)

扫一扫,手机访问

Llama 2-70B一夜之间打败GPT-4,让整个AI社区为之震惊!

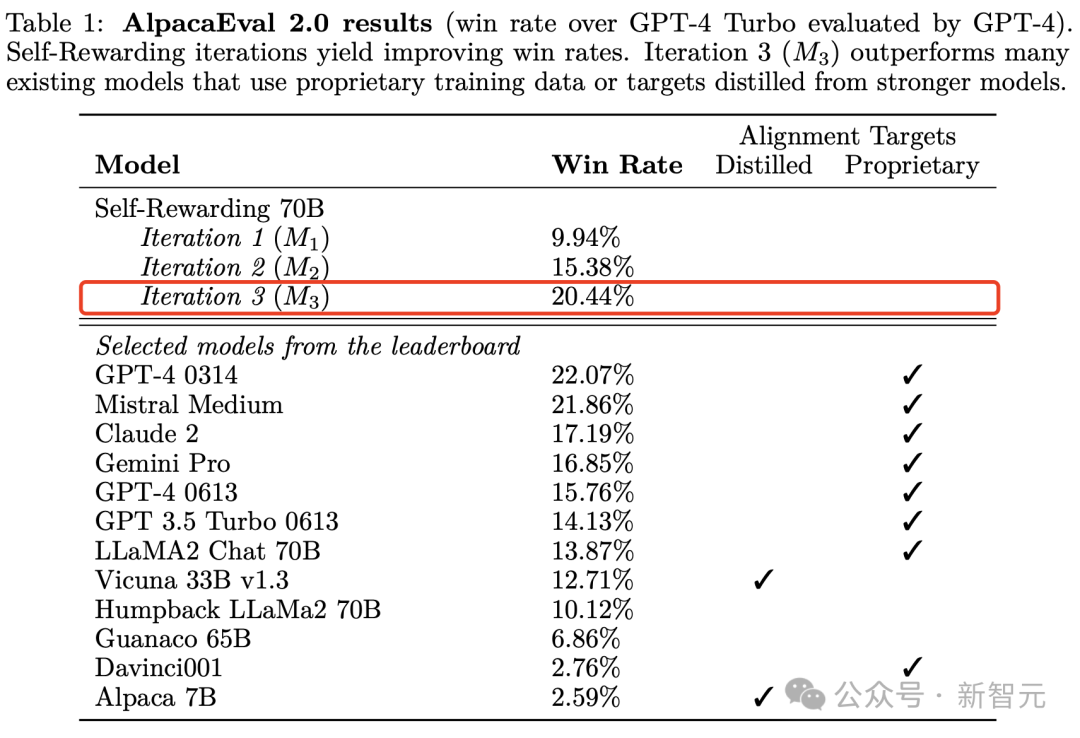

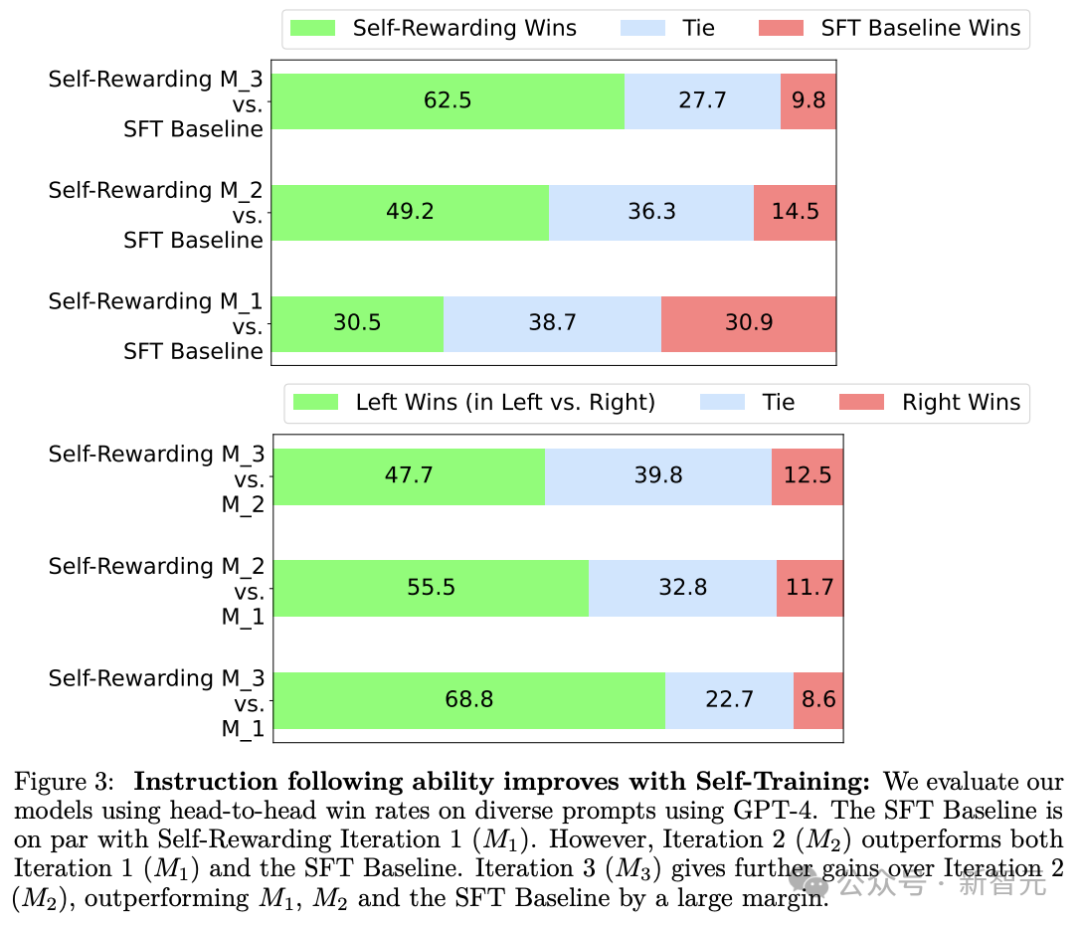

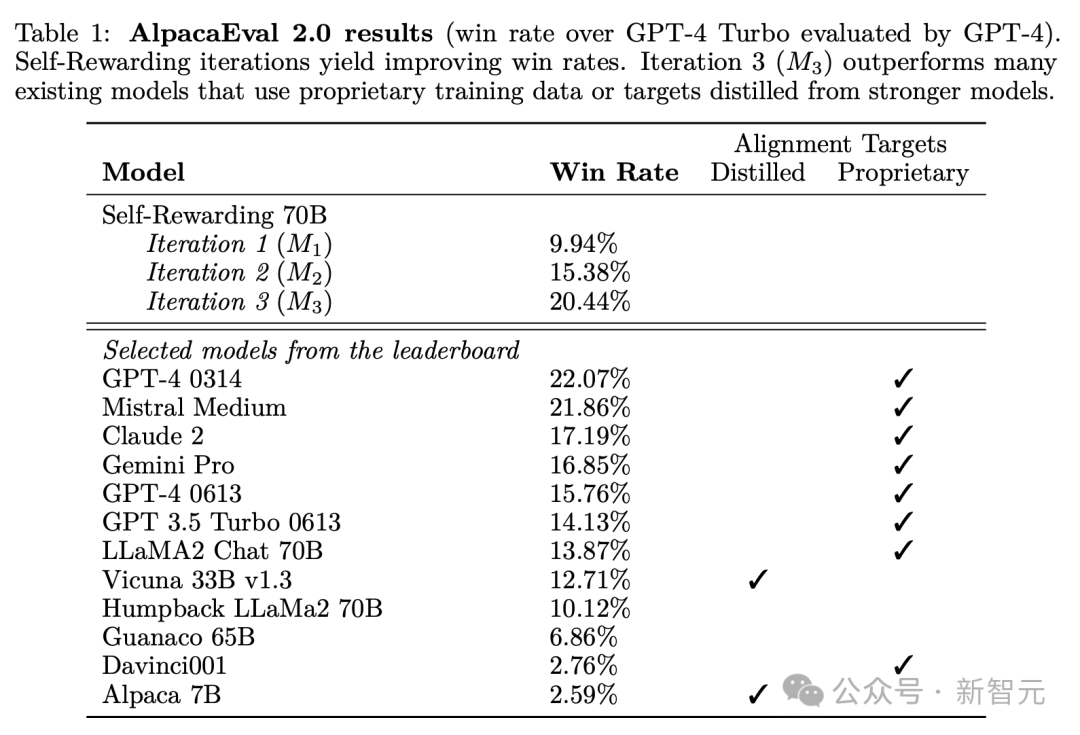

甚至,在AlpacaEval 2.0排行榜中,微调后的模型胜率完全碾压Claude 2、Gemini Pro等模型。

Meta和NYU研究团队究竟提出了什么秘制配方,才能让Llama 2-70B超强进化?

题目所述的「自我奖励语言模型」是一个训练数据生成和评估的模型,它使用生成的数据自行进行训练。

简单来说,最新方法可以让LLM在迭代训练过程中不断自我改进。

论文地址:https://arxiv.org/pdf/2401.10020.pdf

LeCun也转赞了自家实验室的研究。

RLAIF已经不是新鲜事了,之前包括Anthropic,谷歌都推出过自己的「AI训AI」的技术,那么Meta的这项工作和之前的几家的RLAIF区别在哪里呢?

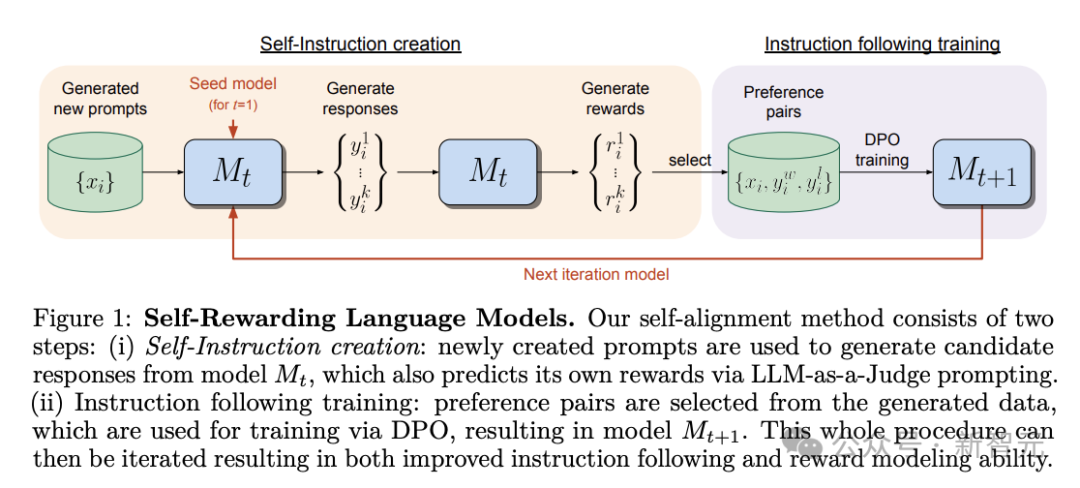

我们先来了解一下Meta的自我奖励语言模型的大概框架。

研究团队开发了一个能够遵循指令和自我评价回复质量的能力的模型。模型可以生成新的训练数据,对生成的回复进行质量评分,从而不断改进自己的输出。

模型首先根据少量人工标注数据进行预训练,获得初始化模型。

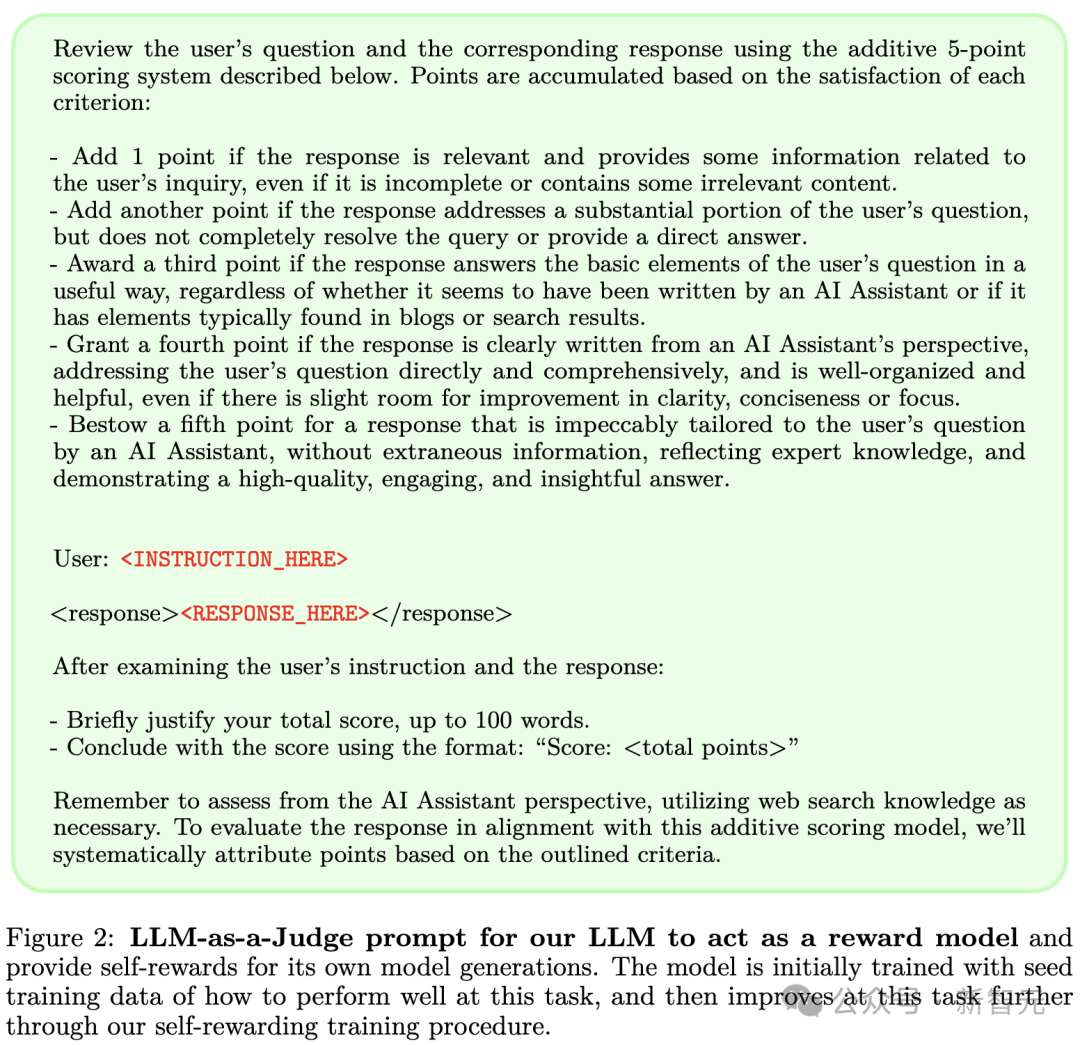

然后模型生成新的指令和多个候选回复,并使用LLM-as-a-Judge的提示,让模型对自己生成的回复打分。

根据打分形成新的训练数据,继续训练模型。

这样可以迭代训练,在每次迭代中模型的遵循指令能力和打分能力都会提升。

研究人员从Llama 2 70B预训练模型开始迭代训练。

结果显示在3次迭代中,模型遵循指令的能力有显著提升,同时奖励建模能力也在提高,评价结果与人工判断的相关性更高。

这说明模型迭代过程中,不仅指令遵循能力提高,也更善于对自己生成的回复进行判断。

迭代第三次的模型在AlpacaEval 2.0基准测试中,就战胜了Claude 2、Gemini Pro、GPT-4 0613等模型。

Meta的这项工作与谷歌在去年9月发布的RLAIF论文相比,更近一步地使用了一个不断进化的奖励模型来不断迭代训练模型,而迭代后的模型也确实取得了明显可见的性能提升。

可以说,Meta又将AI自我迭代大模型的前沿往前推进了一大步。

如何训练「自我奖励语言模型」

研究人员的方法首先假设可以访问基本的预训练语言模型和少量人工注释的种子数据。

然后研究人员建立一个模型,让它同时拥有两种能力:

- 指令遵循:给出描述用户请求的提示,能够生成高质量、有帮助(且无害)的响应。

- 自指令创建:能够按照示例生成和评估新指令,再添加到自己的训练集中。

这两个能力可以为了使模型能够执行自我对齐,即它们是用于使用人工智能反馈(AIF)迭代训练自身的组件。

自指令创建包括生成候选响应,然后模型本身判断其质量——充当自己的奖励模型,取代外部奖励模型。

这是通过LLM-as-a-Judge机制实现的:通过将响应评估制定为遵循指令的任务。

这个由模型自行创建的AIF偏好数据被用作训练集来训练模型。

整体自我对齐过程是一个不断迭代过程,通过构建一系列此类模型来进行,目的是每个模型都比上一个模型有所改进。

重要的是,由于模型既可以提高其生成能力,又可以通过相同的生成机制作为自己的奖励模型,这意味着奖励模型本身可以通过迭代过程来改进,这就不同于奖励模型固定不变的传统方法。

研究人员相信这样可以提高这些学习模型未来自我改进的潜力上限,消除限制性瓶颈。

初始化

种子指令跟随数据

研究人员获得一组人工编写的(指令提示、响应)一般指令。

他们使用这些示例从预训练的基础语言模型开始,用监督微调 (SFT) 的方式进行训练。

种子LLM-as-a-Judge指令跟随数据

研究人员假设他们提供了一组种子(评估指令提示、评估结果响应)示例,这些示例也可用于训练。

虽然这并不是绝对必要的,因为使用IFT数据的模型已经能够训练LLM成为judge,而且研究人员表明此类训练数据可以提供改进的结果。

在这些数据中,输入提示要求模型评估对特定指令的给定响应的质量。

提供的评估结果响应包括思路推理,然后是最终分数(在研究人员的实验中,满分 5 分)。

研究人员为这些提示选择的格式如下图2所示。作为LLM执行奖励模型角色的训练数据。

这些数据被称为评估微调(EFT)数据。

研究人员在训练期间使用这两个种子数据集。

再用3个步骤来创建自我指令:

-使用研究人员已经训练好的模型,研究人员可以让它自我修改自己的训练集。具体来说,就是为下一次训练迭代生成额外的训练数据。

-生成候选响应:然后,对于给定的提示 x,研究人员生成 N 个不同的候选响应 {y, . 。。, y} 。

-评估候选响应:最后,研究人员使用同一模型的LLM-as-a-Judge能力来评估其自己的候选响应,得分为 r∈ [0, 5](见图 2)。

指令遵循训练

训练最初是使用种子 IFT 和 EFT 数据进行的,这与奖励模型固定的标准实践不同。然后通过AI(自我)反馈添加附加数据。

AI反馈训练

执行自指令创建过程后,研究人员可以使用额外的训练示例来扩充种子数据,研究人员将其称为 AI 反馈训练 (AIFT) 数据。

他们尝试了此类反馈的两种变体:

偏好对:研究人员构建以下形式的训练数据(指令提示 x,获胜响应 y,失败响应 y)。为了形成获胜和失败对,研究人员从 N 个评估的候选答案中选取最高和最低得分的答案。

将这些对可用于通过偏好调整算法进行训练。

仅正面示例:在此变体中,研究人员遵循其他方法,将模型策划的(指令提示、响应)附加示例添加到种子集中,以进行监督微调。

整体自对齐算法

迭代训练

研究人员的整个过程训练一系列模型。其中每个连续模型t使用由t − 1模型创建的增强训练数据。

因此,研究人员将AIFT(M)定义为使用模型M创建的AI反馈训练数据。

M:基础预训练LLM,没有微调。

M1:用M初始化,然后使用SFT对IFT+EFT种子数据进行微调。

M2:用M1初始化,然后使用DPO用AIFT(M1)数据进行训练。

M3:用M2初始化,然后使用DPO用AIFT(M2)数据进行训练。

实验结果

如文章开始所提到的那张图中,研究人员将微调后Llama 2-70B三个迭代版本与其他先进模型在AlpacaEval 2.0基准上进行了比较。

结果显示,第三次迭代后的Llama 2-70B模型打败了GPT-4 0613、Claude 2、Gemini Pro等模型。

此外,Llama 2-70B每个迭代版本比较,改进几乎保持线性。

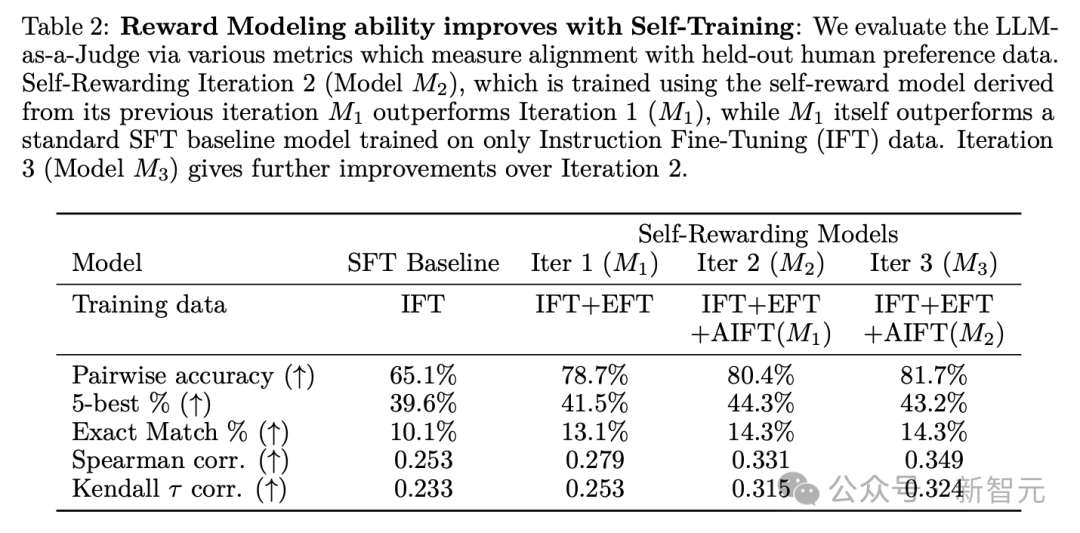

研究人员通过各种指标来评估作为评估者的大模型,这些指标衡量与保留的人类偏好数据的一致性。

自我奖励迭代2(模型M2),使用从其先前迭代M1派生的自我奖励模型进行训练,其性能优于迭代1(M1)。

而M1本身也优于仅利用指令微调(IFT)数据训练的标准SFT基准模型。迭代3(模型 M3)比迭代2有了进一步提高。

在这个框架之中,研究人员发现,奖励模型的性能也能随着迭代不断提高。

模型M2使用来自M1的奖励模型进行训练,与M1相比,在所有五个指标上都体现出了更好的性能。

例如,成对准确(pairwise accuracy)率从78.7%提高到 80.4%。M3继续进一步改进了其中几个指标。

研究人员猜测,是由于模型在指令遵循方面变得更好,因此它在LLM-as-a-Judge的任务方面也有所改进。

网友:让开源再次伟大

Meta和NYU的最新研究让许多人惊呼「让开源再次伟大」。

俄亥俄州立大学计算机工程助理教授Yu Su表示,2024年才刚刚开始,我们已经从合成数据中看到了许多重要成果。我个人认为,这不仅仅是「数据增强」的改头换面。以前的数据增强工作在很大程度上依赖于「人类工程」,而现在更像是LLM的「想象力」...

越来越多的研究表明,「人工训练数据耗尽」不会阻止LLM的发展。

这是DPO的「Attention Is All You Need」的时刻。

还有人表示「令人惊讶的是,每次迭代的改进几乎保持线性,仅在3次迭代之后,就已经接近GPT-4级别」。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

-

正版软件

正版软件

- 解释模型的方法和意义是什么(模型可解释性的定义)

- 模型可解释性是指人们能够理解机器学习模型的决策规则和预测结果的程度。它涉及到理解模型的决策过程和模型如何根据输入数据进行预测或分类。在机器学习领域,模型可解释性是一个重要的话题,因为它有助于人们了解模型的局限性、不确定性和潜在偏差,从而增强模型的信任度和可靠性。通过理解模型的决策规则,人们可以更好地评估模型在不同情况下的表现,并作出相应的决策。此外,模型可解释性还可以帮助人们发现模型中的错误或偏见,并提供改进模型的方向。因此,提高模型的可解释性对于机器学习的应用和发展都具有重要意义。下面介绍几种常见的模型

- 14分钟前 机器学习 0

-

正版软件

正版软件

- 解析决策树模型及其与过拟合问题的关系

- 决策树是一种监督机器学习模型,利用带有标记的输入和目标数据进行训练。它通过树状结构表示决策过程,根据前几组标签/节点的回答来进行决策。决策树的优点在于它模仿人类思维的逻辑流程,使结果和过程更易于理解和解释。与线性模型不同,决策树能够处理变量之间的非线性关系。主要用于解决分类问题,通过模型对对象进行分类或分类。此外,在机器学习中,决策树也可用于解决回归问题。决策树的结构决策树通过递归分区构建,树的根位于顶部。根节点包含所有训练数据。从根节点开始,每个节点可以分裂为左右子节点。叶节点是没有进一步分裂的末端节点

- 29分钟前 人工智能 机器学习 0

-

正版软件

正版软件

- 自监督学习框架与监督学习、无监督学习之间的关联

- 自监督学习(SSL)是一种无需人工输入数据标记的监督学习形式。它通过独立分析数据、标记和分类信息的模型来获得结果,而无需任何人工干预。这种方法可以减少人工标注的工作量,提高训练效率,并且在大规模数据集上表现出色。SSL是一种有前景的学习方法,可以在各种领域中应用,如计算机视觉和自然语言处理。自监督学习是一种利用未标记数据来生成监督信号的无监督学习方式。简单来说,它通过生成高置信度的数据标签来训练模型,然后在下一次迭代中使用这些标签。在每次迭代中,基于数据标签的基本事实都会发生变化。这种方法可以有效地利用未

- 44分钟前 机器学习 0

-

正版软件

正版软件

- 即将上市的三星Galaxy Ring指环:AI健康监测成突出特点

- 三星在今日举办的GalaxyS24系列发布会上,向全球消费者展示了他们的最新智能穿戴产品——GalaxyRing智能指环。这款创新产品的亮相为整个科技盛宴增添了一抹亮色。在发布会即将结束之际,三星通过一段精彩的预告片向公众展示了GalaxyRing的迷人魅力。这款智能指环的设计独特,它像一枚时尚的戒指,轻松佩戴在手指上。指环内侧集成了多个先进传感器,结合AI技术,为用户提供全方位的健康追踪服务。然而,预告片并未透露GalaxyRing的售价和上市时间等更多细节。用户期待能尽快了解这款智能指环的详细信息,以

- 59分钟前 三星 0

最新发布

-

1

1

- 阿里追捧的中台,“热度”退了?

- 1800天前

-

2

2

- Overture设置踏板标记的方法

- 1637天前

-

3

3

- 思杰马克丁取得CleanMyMac中国区独家发行授权

- 1627天前

-

4

4

- IBM:20万台Mac让公司职工在工作中更快乐 更多产

- 1825天前

-

5

5

- 报道称微软一直在悄然游说反对“维修权”立法!

- 1791天前

-

6

6

- 美国怀疑华为窃取商业机密 华为:身正不怕影子斜

- 1787天前

-

7

7

- 三星被曝正与联发科接洽 A系列手机有望搭载其5G芯片

- 1802天前

-

8

8

- 环球墨非完成千万级融资 联合企业集团投资

- 1823天前

-

9

9

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00