Transformer模型:一种综合介绍(transformer结构的应用领域)

发布于2024-11-14 阅读(0)

发布于2024-11-14 阅读(0)

扫一扫,手机访问

Transformers是一种使用自注意力机制的模型,它采用编码器-解码器架构来实现结果。一些常见的基于Transformer架构的模型包括BERT和RoBERTa。

Transformer架构是专为处理自然语言处理任务中的序列到序列问题而设计的。相对于传统的RNN、LSTM等架构,Transformer的主要优势在于其独特的自注意力机制。这种机制使得Transformer能够准确地捕捉输入句子中标记之间的远程依赖和相关性,并且大大降低了计算时间。通过自注意力机制,Transformer能够对输入序列中的每个位置进行自适应的加权处理,从而更好地捕捉到不同位置的上下文信息。这种机制使得Transformer在处理长距离依赖性时更加有效,从而在许多自然语言处理任务中取得了优异的性能。

这种架构基于编码器-解码器,由多层编码器和解码器组成。每个编码器包含多个子层,包括多头自注意力层和位置全连接前馈神经网络。同样,每个解码器也有两个相同的子层,并添加了一个名为编码解码器注意力层的第三个子层,该层应用于编码器堆栈的输出。

每个子层后面都有一个归一化层,同时每个前馈神经网络周围都有残差连接。这种残差连接提供了梯度和数据流的自由路径,有助于在训练深度神经网络时避免梯度消失的问题。

编码器的注意力向量被传送到前馈神经网络,将其转化为向量表示,并传递至下一个注意层。解码器的任务是将编码器的注意力向量转化为输出数据。在训练阶段,解码器可以使用编码器生成的注意力向量和预期结果。

解码器使用相同的标记化、词嵌入和注意力机制,以处理预期结果并生成注意力向量。随后,该注意力向量与编码器模块中的注意力层进行交互,以建立输入和输出值之间的关联。解码器注意力向量经过前馈层的处理,再映射为目标数据大小的大向量。

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- 解释性算法在机器学习中的概述

- 机器学习中一个重要的问题是理解模型预测的原因。虽然我们可以通过现有的算法模型知道算法的功能,但很难解释为什么模型会得出这样的预测结果。然而,解释性算法可以帮助我们识别我们感兴趣的结果和有意义的变量影响。解释性算法让我们能够理解模型中变量之间的关系,而不仅仅是用来预测结果。因此,通过使用多种算法,我们可以更好地理解给定模型中自变量和因变量之间的关系。解释性算法线性/逻辑回归是一种统计方法,用于建模因变量与一个或多个自变量之间的线性关系。该方法通过检验和系数,可以帮助我们了解变量之间的关系。决策树是一种机器学

- 1小时前 23:00 机器学习 0

-

正版软件

正版软件

- 揭秘iOS 17天气应用亮点:回顾昨日天气并预测未来10天下雨概率

- 6月8日消息,苹果最新发布的iOS17开发者预览版更新带来了一系列令人瞩目的改进,其中包括对天气应用的优化。据了解,iOS17的天气应用在用户界面和功能方面进行了多项增强,使用户可以更加方便地获取天气信息。首先,iOS17的天气应用新增了一个重要的功能,用户现在可以查看昨日的天气情况。这一改进让用户能够回顾过去一天的天气状况,不再局限于当天和未来10天的预报。无论是回顾旅行中的天气还是追溯历史天气数据,用户都能更全面地了解过去的天气情况。另外,iOS17还在未来10天的天气预报中增加了下雨可能性的显示,并

- 1小时前 22:55 苹果 0

-

正版软件

正版软件

- 深入了解RNN、LSTM和GRU的概念、异同和优缺点

- 在时间序列数据中,观察之间存在依赖关系,因此它们不是相互独立的。然而,传统的神经网络将每个观察看作是独立的,这限制了模型对时间序列数据的建模能力。为了解决这个问题,循环神经网络(RNN)被引入,它引入了记忆的概念,通过在网络中建立数据点之间的依赖关系来捕捉时间序列数据的动态特性。通过循环连接,RNN可以将之前的信息传递到当前观察中,从而更好地预测未来的值。这使得RNN成为处理时间序列数据任务的强大工具。但是RNN是如何实现这种记忆的呢?RNN通过神经网络中的反馈回路实现记忆,这是RNN与传统神经网络的主要

- 1小时前 22:40 人工智能 机器学习 人工神经网络 0

-

正版软件

正版软件

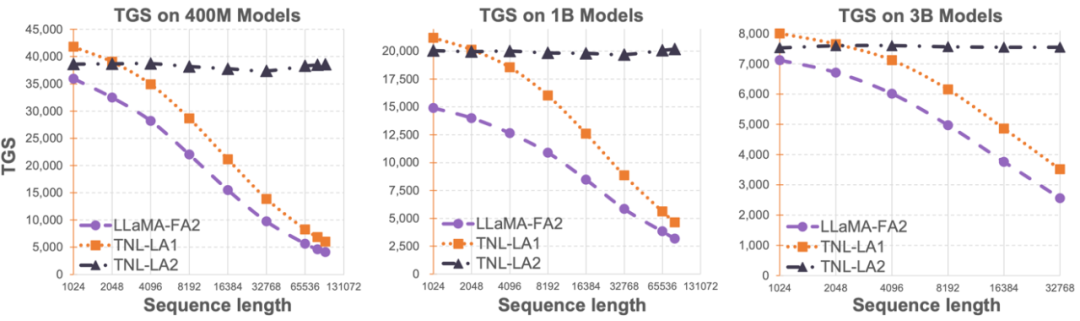

- 进阶版Lightning Attention-2:无限序列长度、持续稳定计算力、增强建模精度

- 当前大语言模型的应用受到了序列长度限制的制约,这限制了其在人工智能领域中的应用。例如,在多轮对话、长文本理解和多模态数据处理与生成方面存在一定的挑战。造成这种限制的根本原因是目前大语言模型普遍采用的Transformer架构,其计算复杂度与序列长度呈二次关系。因此,随着序列长度的增加,计算资源的需求会呈几何倍数增长。因此,如何高效地处理长序列一直是大语言模型所面临的挑战之一。过去的方法主要集中在让大语言模型在推理阶段适应更长的序列。其中一种方法是采用Alibi或类似的相对位置编码,以使模型能够自适应不同长

- 1小时前 22:25 模型 训练 0

-

正版软件

正版软件

- 利用人工智能实现图像超分辨率重构

- 超分辨率图像重建是利用深度学习技术,如卷积神经网络(CNN)和生成对抗网络(GAN),从低分辨率图像中生成高分辨率图像的过程。该方法的目标是通过将低分辨率图像转换为高分辨率图像,从而提高图像的质量和细节。这种技术在许多领域都有广泛的应用,如医学影像、监控摄像、卫星图像等。通过超分辨率图像重建,我们可以获得更清晰、更具细节的图像,有助于更准确地分析和识别图像中的目标和特征。重建方法超分辨率图像重建的方法通常可以分为两类:基于插值的方法和基于深度学习的方法。1)基于插值的方法基于插值的超分辨率图像重建方法是一

- 1小时前 22:10 人工智能 计算机视觉 图像处理 0

最新发布

-

1

1

- 阿里追捧的中台,“热度”退了?

- 1800天前

-

2

2

- Overture设置踏板标记的方法

- 1637天前

-

3

3

- 思杰马克丁取得CleanMyMac中国区独家发行授权

- 1627天前

-

4

4

- IBM:20万台Mac让公司职工在工作中更快乐 更多产

- 1826天前

-

5

5

- 报道称微软一直在悄然游说反对“维修权”立法!

- 1791天前

-

6

6

- 美国怀疑华为窃取商业机密 华为:身正不怕影子斜

- 1787天前

-

7

7

- 三星被曝正与联发科接洽 A系列手机有望搭载其5G芯片

- 1802天前

-

8

8

- 环球墨非完成千万级融资 联合企业集团投资

- 1824天前

-

9

9

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00