爬虫实战:探索推特数据并分析用户情感

发布于2024-11-13 阅读(0)

发布于2024-11-13 阅读(0)

扫一扫,手机访问

随着社交媒体的日益普及,大量的用户产生了海量的数据,而这些数据蕴含了巨大的商业价值。为了更好地利用这些数据,我们需要一种能够自动化地获取数据并进行分析的工具。Scrapy正是这样一个强大的爬虫框架,Scrapy能够帮助我们快速的获取大量的数据,并作各种形式的统计分析。

在这篇文章中,我将向大家介绍如何使用Scrapy框架来爬取推特数据,并通过的分析分析分析用户情感。

第一步:安装Scrapy

首先,你需要确保你的电脑上已经安装好了Python环境,接着在命令行中输入下面的语句就可以安装Scrapy了:

pip install scrapy

这个过程可能需要一些时间,因为Scrapy的安装包比较大。

第二步:创建Scrapy项目

在安装好了Scrapy之后,我们需要创建一个新的Scrapy项目。假设我们的项目名为"twitter",在命令行中输入:

scrapy startproject twitter

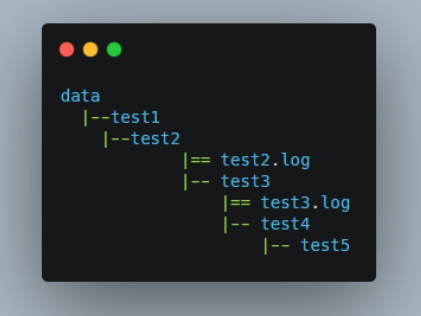

执行后,将会在当前目录下创建一个名为"twitter"的文件夹,其中包含了Scrapy框架所需的各种文件和文件夹。

第三步:编写爬虫代码

完成Scrapy项目的创建之后,我们需要编写爬虫代码。在Scrapy中,爬虫代码写在spiders目录下的.py文件中,我们需要先创建一个新的.py文件,假设我们的文件名为"twitter_spider.py",在命令行中输入:

scrapy genspider twitter_spider twitter.com

执行完上面的命令后,将会在spiders目录下创建一个名为"twitter_spider.py"的文件,并默认以"twitter.com"为初始URL。

接着,我们需要在"twitter_spider.py"中编写代码来实现对推特网站数据的爬取。下面是一个简单的示例:

import scrapy

class TwitterSpider(scrapy.Spider):

name = "twitter_spider"

allowed_domains = ["twitter.com"]

start_urls = ["https://twitter.com/search?q=feminist&src=typed_query"]

def parse(self, response):

filename = response.url.split("/")[-2] + ".html"

with open(filename, 'wb') as f:

f.write(response.body)

self.log('保存文件: %s' % filename)

代码中,我们指定了爬虫的名称为"twitter_spider",允许访问的域名为"twitter.com",并将初始URL设置为"https://twitter.com/search?q=feminist&src=typed_query"。当爬虫访问这个URL时,它会调用parse方法对网页内容进行解析。在示例中,我们将爬取到的网页保存到本地,并输出保存的文件名。

第四步:运行Scrapy爬虫

编写好爬虫代码之后,我们需要运行Scrapy框架来执行爬虫任务。在命令行中输入:

scrapy crawl twitter_spider

执行命令后,爬虫将会开始运行,运行完成后,爬取到的数据将会保存到本地。

第五步:分析用户情感

现在,我们已经成功地使用Scrapy框架爬取到了推特数据。接下来,我们需要对数据进行分析,分析推特用户的情感倾向。

在分析用户情感中,我们可以使用一些情感分析的第三方库来解析文本,并确定情感的强度。例如,Python中的TextBlob情感分析库可以帮助我们判断文本中所包含的情感,并输出情感得分。

使用TextBlob的代码如下:

from textblob import TextBlob

blob = TextBlob("I love this place.")

print(blob.sentiment)

输出结果中,情感得分介于-1和1之间,如果得分为-1,表示完全负面的情感;得分为0,表示情感中立;得分为1,表示完全正面的情感。

现在,我们可以将这个情感分析函数应用到我们爬取的推特数据集中,得到每个用户所表达的情感得分,并进一步分析用户的情感倾向是积极还是消极。

综上所述,Scrapy是一个灵活、强大的爬虫框架,可以帮助我们快速获取海量的数据,并作出更好的分析。通过对分析推特用户情感,我们可以更好地了解用户的喜好和态度,进而制定更有效的推广策略。

上一篇:学习Go语言微服务开发的终极指南

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

- 使用Golang继承方法的技巧和注意事项

- Golang继承方法的使用技巧与注意事项在Golang中,继承是一种非常重要的面向对象编程概念。通过继承,可以创建一个新的类型,并使其获取父类型的属性和方法。本文将介绍Golang中继承方法的使用技巧与注意事项,并附带具体的代码示例。一、继承方法的基本概念在Golang中,继承是通过嵌入类型实现的。我们可以在一个结构体中嵌入另一个结构体,这样被嵌入的结构体就

- 9分钟前 方法 Golang 继承 0

-

正版软件

- 使用Nginx反向代理实现静态网页访问加速的缓存配置

- Nginx反向代理缓存配置,实现静态网页访问加速简介:随着互联网的快速发展,访问速度成为了网站运营中非常重要的一个因素。为了提高网页的访问速度,我们可以使用Nginx反向代理缓存技术来实现网页的加速。本文将介绍如何使用Nginx配置反向代理缓存来实现静态网页的加速。Nginx反向代理缓存配置:安装Nginx:首先需要安装Nginx服务器,可以通过apt-ge

- 24分钟前 nginx 反向代理 缓存配置 0

-

正版软件

- 实践中的PHP网络爬虫:获取淘宝商品信息

- PHP是许多网站开发和数据处理任务中非常重要的一种编程语言。而在实际应用中,我们常常需要获取各大电商平台的商品数据来进行分析和处理。因此,本文重点介绍如何利用PHP来实现一个基于淘宝开放平台的爬虫,来抓取淘宝商品数据。一、准备工作在开始之前,需要先申请淘宝开放平台的开发者账号,并创建一个应用。这里不再赘述具体操作步骤,读者可以参考淘宝开放平台提供的相关文档进

- 39分钟前 PHP 爬虫 数据获取 0

-

正版软件

- 介绍Java语言中的在线支付应用开发指南

- 随着网络技术的不断发展和普及,线上支付的需求也越来越高。作为一门广泛应用于企业级开发的编程语言,Java提供了丰富的库和工具,方便开发者开发高效、安全、可维护的在线支付应用。本文将介绍Java语言中的在线支付应用开发,包括相关技术、安全性和流程。一、在线支付相关技术1.1网关网关是在线支付过程中的关键技术。它用于连接商家和支付服务提供商之间的交易流程,并确

- 54分钟前 开发 Java 在线支付 0

-

正版软件

- 深入理解PHP缓存机制的原理与应用:完全解析

- PHP缓存机制全解析:深入理解其原理与应用引言:在开发Web应用程序中,缓存是一种重要的技术手段,能够显著提升应用程序的性能和用户体验。而PHP作为一种常用的服务器端编程语言,也提供了丰富的缓存机制供开发者使用。本文将深入探讨PHP缓存机制的原理与应用,并给出具体的代码示例。一、缓存的原理在介绍PHP缓存机制之前,我们需要了解缓存的基本原理。缓存是一种将数据

- 1小时前 14:05 深入理解 原理与应用 PHP缓存机制 0

最新发布

-

1

1

-

2

2

-

3

- Vue组件中如何处理图片预览和缩放问题

- 393天前

-

4

- WebSocket协议的优势与劣势分析

- 394天前

-

5

5

-

6

- java动态代理实例代码分析

- 564天前

-

7

7

-

8

8

- Python实战教程:批量转换多种音乐格式

- 564天前

-

9

9

- java io文件操作删除文件或文件夹的方法

- 561天前

相关推荐

热门关注

-

- Xshell 6 简体中文

- ¥899.00-¥1149.00

-

- DaVinci Resolve Studio 16 简体中文

- ¥2550.00-¥2550.00

-

- Camtasia 2019 简体中文

- ¥689.00-¥689.00

-

- Luminar 3 简体中文

- ¥288.00-¥288.00

-

- Apowersoft 录屏王 简体中文

- ¥129.00-¥339.00