研究难题轻松解决,尝试GPT的高效能力

发布于2024-12-16 阅读(0)

发布于2024-12-16 阅读(0)

扫一扫,手机访问

使用 Kubernetes 时难免会遇到集群中的问题,需要进行调试和修复,以确保 Pod 和服务能够正常运行。无论你是初学者还是处理复杂环境的专家,调试集群内的进程并不总是易事,可能会变得耗时且繁琐。 在 Kubernetes 中,诊断问题的关键是了解各个组件之间的关系,以及它们如何相互作用。日志记录和监控工具是解决问题的关键,可以帮助你快速定位并解决故障。另外,深入了解 Kubernetes 资源配置和调度机制也是解决问题的重要一环。 当面对问题时,首先要确保你的集群和应用程序的配置是正确的。随后,通过查看日志、监控指标和事件,来定位问题的根源。有时候问题可能涉及到网络配置、存储问题或者是应用程序本身的 bug,需要仔

在云原生环境中,有多种调试解决方案可供选择,可以帮助您轻松访问集群内的信息。但需要注意的是,大部分解决方案并未提供完整的上下文信息。

在这篇博文中,我将向你介绍K8sGPT,这个项目旨在为所有人提供 Kubernetes 的超能力。

K8sGPT 的应用场景

K8sGPT 的应用场景

概述

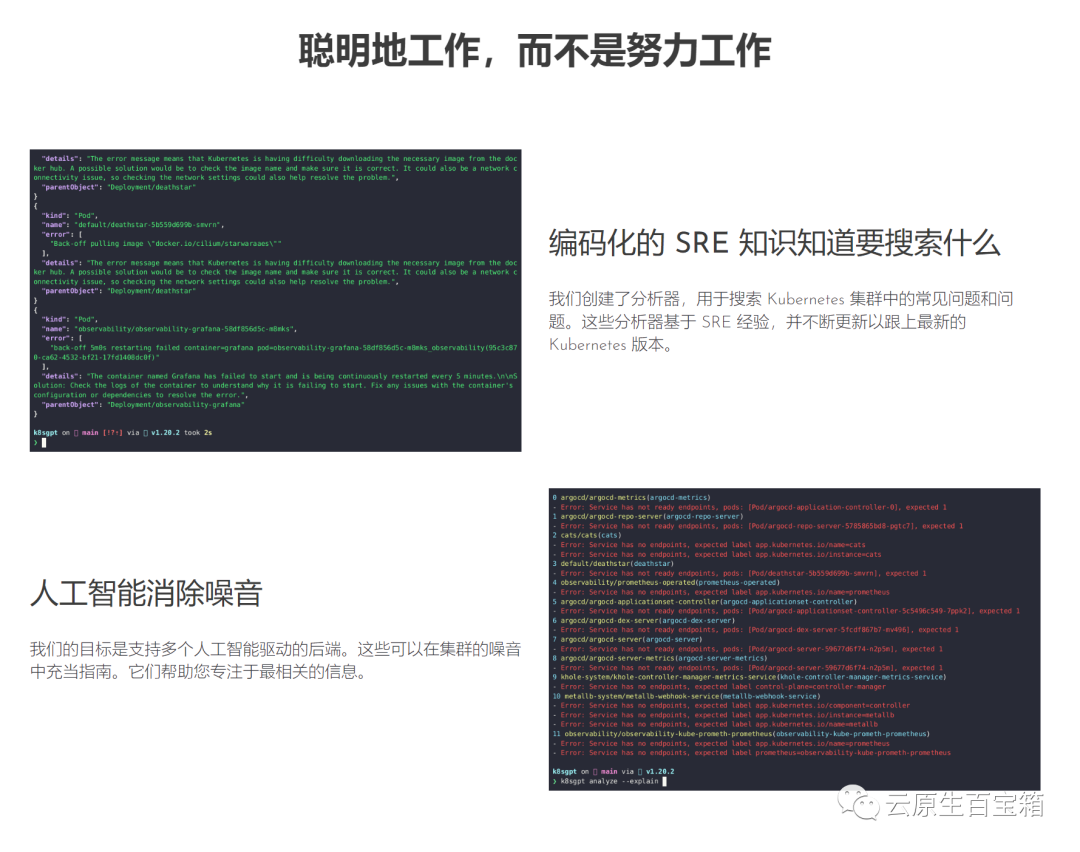

K8sGPT是一项完全开源的项目,由一群经验丰富的云原生生态系统工程师于2023年4月发起。该项目的核心理念是利用人工智能模型,为Kubernetes错误消息和集群洞见提供详尽且情境化的解释。

图片

图片

此项目已被两个组织采用并申请成为 CNCF 沙箱项目。该项目的远景是为 Kubernetes 打造面向任务的机器学习模型。

该项目已经支持多种安装选项和不同的人工智能后端。在这篇文章中,我将向您介绍如何安装和开始使用 K8sGPT、CLI 工具和 Operator,以及 K8sGPT 如何支持其他集成。

安装

根据你的偏好和操作系统,有多种安装选项可用。你可以在K8sGPT文档的安装部分找到不同的选项。

如下所述安装 K8sGPT 的先决条件是在 Mac 上安装Homebrew或在 Windows 计算机上安装 WSL。

接下来,你可以运行以下命令:

brew tap k8sgpt-ai/k8sgptbrew install k8sgpt

其他安装选项

基于 RPM 的安装 (RedHat/CentOS/Fedora)

32位:

curl -LO https://github.com/k8sgpt-ai/k8sgpt/releases/download/v0.3.6/k8sgpt_386.rpmsudo rpm -ivh k8sgpt_386.rpm

64 位:

curl -LO https://github.com/k8sgpt-ai/k8sgpt/releases/download/v0.3.6/k8sgpt_amd64.rpmsudo rpm -ivh -i k8sgpt_amd64.rpm

基于 DEB 的安装 (Ubuntu/Debian)

32位:

curl -LO https://github.com/k8sgpt-ai/k8sgpt/releases/download/v0.3.6/k8sgpt_386.debsudo dpkg -i k8sgpt_386.deb

64 位:

curl -LO https://github.com/k8sgpt-ai/k8sgpt/releases/download/v0.3.6/k8sgpt_amd64.debsudo dpkg -i k8sgpt_amd64.deb

要验证 K8sGPT 是否安装正确,你可以检查安装的版本:

k8sgpt versionk8sgpt: 0.3.6 (9c0efe6), built at: unknown

K8sGPT CLI

要查看 K8sGPT 提供的所有命令,请使用 --help 标志:

k8sgpt --help

接下来,我们必须授权AI后端。在本文中,我们将使用 OpenAI。

先决条件

遵循下一节的先决条件是拥有一个OpneAI 帐户和一个正在运行的 Kubernetes 集群,例如 microk8s 或 minikube 就足够了。

拥有 OpneAI 帐户后,你需要访问这个地址https://platform.openai.com/account/api-keys生成新的 API 密钥

或者,你可以运行以下命令,K8sGPT 将在默认浏览器中打开同一地址:

k8sgpt generate

K8sGPT 与 OpenAI 交互需要此密钥。使用新创建的 API 密钥/令牌授权 K8sGPT:

k8sgpt auth add openaiEnter openai Key: openai added to the AI backend provider list

你可以使用以下命令列出你的后端:

k8sgpt auth listDefault:> openaiActive:> openaiUnused:> localai> azureopenai> noopai

接下来,我们将在 Kubernetes 集群中部署一个异常的Deployment,Pod 将成为CrashLoopBackOff状态。以下是 YAML:

apiVersion: apps/v1kind: Deploymentmetadata:name: nginx-deploymentlabels:app: nginxspec:replicas: 3selector:matchLabels:app: nginxtemplate:metadata:labels:app: nginxspec:containers:- name: nginximage: nginx:1.14.2ports:- containerPort: 80securityContext:readOnlyRootFilesystem: true

接下来,我们将为示例应用程序创建demo命名空间并安装部署:

kubectl create ns demonamespace/demo createdkubectl apply -f ./deployment.yaml -n demodeployment.apps/nginx-deployment created

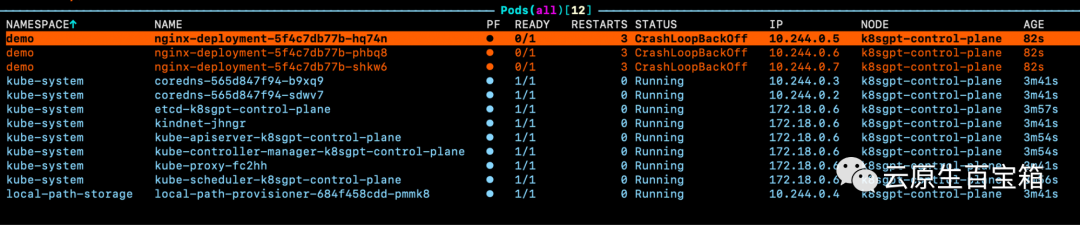

现在你将看到我们的演示命名空间中的 Pod 抛出错误:

图片

图片

如果我们查看其中一个 pod 的事件,但是我们不知道具体问题原因:

WarningBackOff 3s (x8 over 87s)kubelet Back-off restarting failed container

因此,我们可以运行 K8sGPT 命令来访问有关这些 pod 出错原因的更多详细信息:

k8sgpt analyse

这将向我们展示 k8sGPT 在集群中发现的问题:

AI Provider: openai0 demo/nginx-deployment-5f4c7db77b-hq74n(Deployment/nginx-deployment)- Error: back-off 1m20s restarting failed cnotallow=nginx pod=nginx-deployment-5f4c7db77b-hq74n_demo(7854b793-21b7-4f81-86e5-dbb4113f64f4)1 demo/nginx-deployment-5f4c7db77b-phbq8(Deployment/nginx-deployment)- Error: back-off 1m20s restarting failed cnotallow=nginx pod=nginx-deployment-5f4c7db77b-phbq8_demo(74038531-e362-45a6-a436-cf1a6ea46d8a)2 demo/nginx-deployment-5f4c7db77b-shkw6(Deployment/nginx-deployment)- Error: back-off 1m20s restarting failed cnotallow=nginx pod=nginx-deployment-5f4c7db77b-shkw6_demo(2603f332-3e1c-45da-8080-e34dd6d956ad)

要接收更多信息以及有关如何解决问题的建议,我们可以使用以下--explain标志:

k8sgpt analyse --explain

附加功能

根据你的集群大小和 K8sGPT 在集群中识别的问题数量,你还可以按特定命名空间和工作负载类型进行过滤。

此外,如果你或你的组织担心 OpenAI 或其他后端接收有关你的工作负载的敏感信息,你可以使用--anonymize规避应用的敏感信息。

与其他工具的集成

云原生生态系统中大多数工具的价值源于它们与其他工具的集成程度。

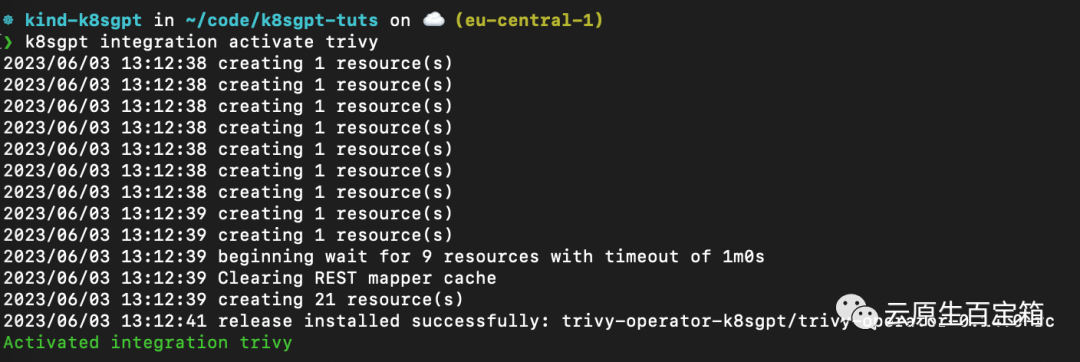

在撰写本文时,K8sGPT 提供了与 Gafana 和 Prometheus 等可观察性工具的轻松集成。此外,还可以为 K8sGPT 编写插件。维护者提供的第一个插件是Trivy,一个一体化的云原生安全扫描器。

你可以使用以下命令列出所有可用的集成:

k8sgpt integration listActive:Unused:> trivy

接下来,我们要激活 Trivy 集成:

k8sgpt integration activate trivy

这将在集群内安装 Trivy Operator(如果尚未安装):

图片

图片

激活集成后,我们可以通过 k8sgpt 过滤器,使用 Trivy 创建的漏洞报告作为 K8sGPT 分析的一部分:

❯ k8sgpt filters listActive:> Pod> VulnerabilityReport (integration)Unused:> Deployment> ReplicaSet> Node> Service> Ingress> StatefulSet> CronJob> PersistentVolumeClaim> HorizontalPodAutoScaler> PodDisruptionBudget> NetworkPolicy

过滤器对应于 k8sgpt 代码中的特定分析器。分析器仅查看相关信息,例如最关键的漏洞。

要使用 VulnerabilityReport 过滤器,请使用以下命令:

k8sgpt analyse --filter=VulnerabilityReport

(FIXME)与之前类似,我们也可以要求 K8sGPT 对扫描提供进一步的解释:

k8sgpt analyse --filter=VulnerabilityReport --explain

K8sGPT Operator

虽然 CLI 工具为集群管理员提供了对其基础设施和工作负载执行即席扫描的功能,但 K8sGPT Operator 在集群中全天候 (24/7) 运行。它是 Kubernetes 原生的,这意味着它作为 Kubernetes 自定义资源运行,并生成作为 YAML 清单存储在集群中的报告。

要安装 Operator,请按照以下命令进行操作:

helm repo add k8sgpt https://charts.k8sgpt.ai/helm repo updatehelm install release k8sgpt/k8sgpt-operator -n k8sgpt-operator-system --create-namespace

如果你想将 K8sGPT 与 Prometheus 和 Grafana 集成,你可以通过向上面的安装提供values.yaml 清单来使用略有不同的安装:

serviceMonitor:enabled: trueGrafanaDashboard:enabled: true

然后安装 Operator 或更新现有安装:

helm install release k8sgpt/k8sgpt-operator -n k8sgpt-operator-system --create-namespace --values values.yaml

在本例中,我们告诉 K8sGPT 还安装一个 ServiceMonitor,它将扫描报告中的指标发送到 Prometheus,并为 K8sGPT 创建一个仪表板。如果你使用了此安装,则还需要安装 kube-prometheus-stack Helm Chart 才能访问 Grafana 和 Prometheus。这可以通过以下命令来完成:

helm repo add prometheus-community https://prometheus-community.github.io/helm-chartshelm repo updatehelm install prom prometheus-community/kube-prometheus-stack -n k8sgpt-operator-system --set prometheus.prometheusSpec.serviceMonitorSelectorNilUsesHelmValues=false

此时,你应该在集群内运行 K8sGPT Operator 和 Prometheus Stack Helm Chart(也是 Kubernetes Operator)。

与我们需要向 CLI 提供 OpenAI API 密钥的方式类似,我们需要使用 API 密钥创建 Kubernetes 密钥。为此,请使用与之前相同的密钥,或者在你的 OpenAI 帐户上生成一个新密钥。

要生成 Kubernetes 密钥,请将你的 OpenAI 密钥粘贴到以下命令中:

export OPENAI_TOKEN=<YOUR API KEY HERE>kubectl create secret generic k8sgpt-sample-secret --from-literal=openai-api-key=$OPENAI_TOKEN -n k8sgpt-operator-system

然后,我们需要配置 K8sGPT Operator 以了解要使用哪个版本的 K8sGPT 以及哪个 AI 后端:

apiVersion: core.k8sgpt.ai/v1alpha1kind: K8sGPTmetadata:name: k8sgpt-samplespec:model: gpt-3.5-turbobackend: openainoCache: falseversion: v0.3.2enableAI: truesecret:name: k8sgpt-sample-secretkey: openai-api-key

现在,我们需要将此文件应用到我们的 K8sGPT 集群命名空间:

kubectl apply -f k8sgpt-resource.yaml -n k8sgpt-operator-system

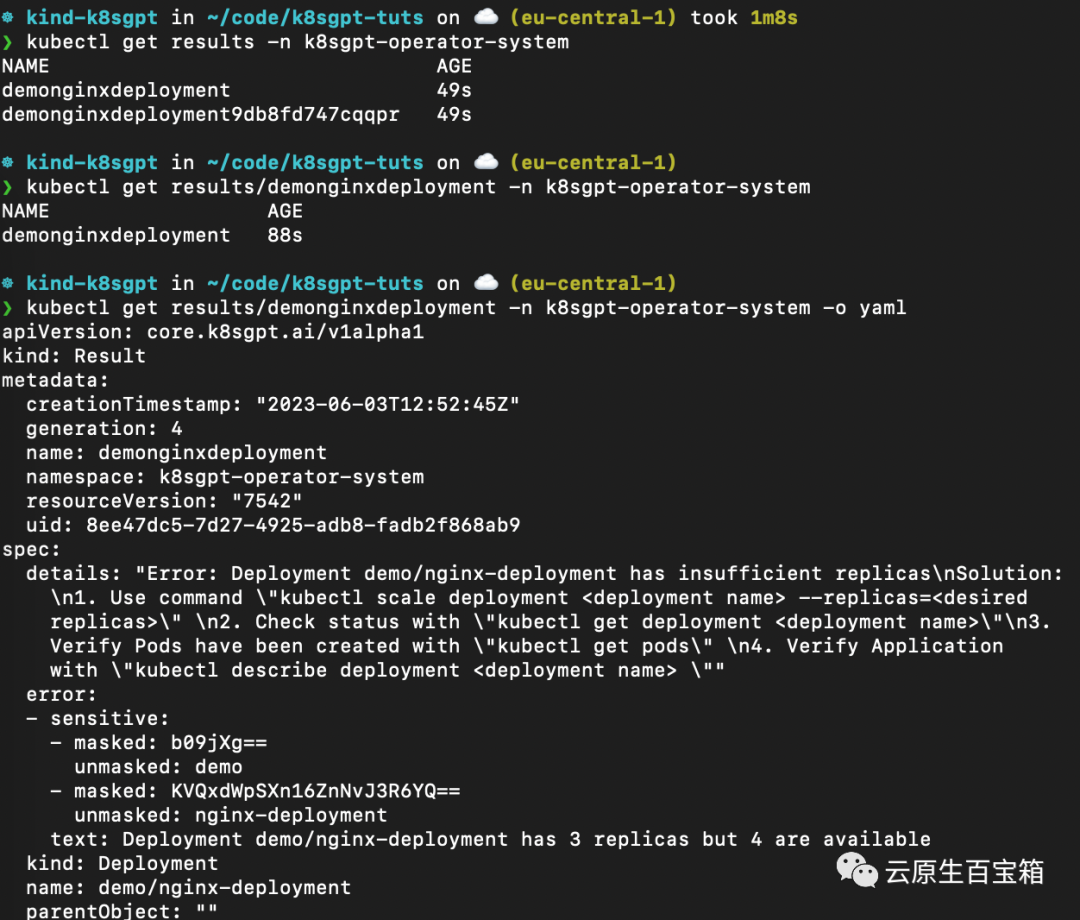

几秒钟内,Operator 将创建新结果:

kubectl get results -n k8sgpt-operator-system

以下是不同命令的屏幕截图,你可以按照这些命令从 K8sGPT Operator 查看结果报告:

从 K8sGPT Operator 查看结果报告

从 K8sGPT Operator 查看结果报告

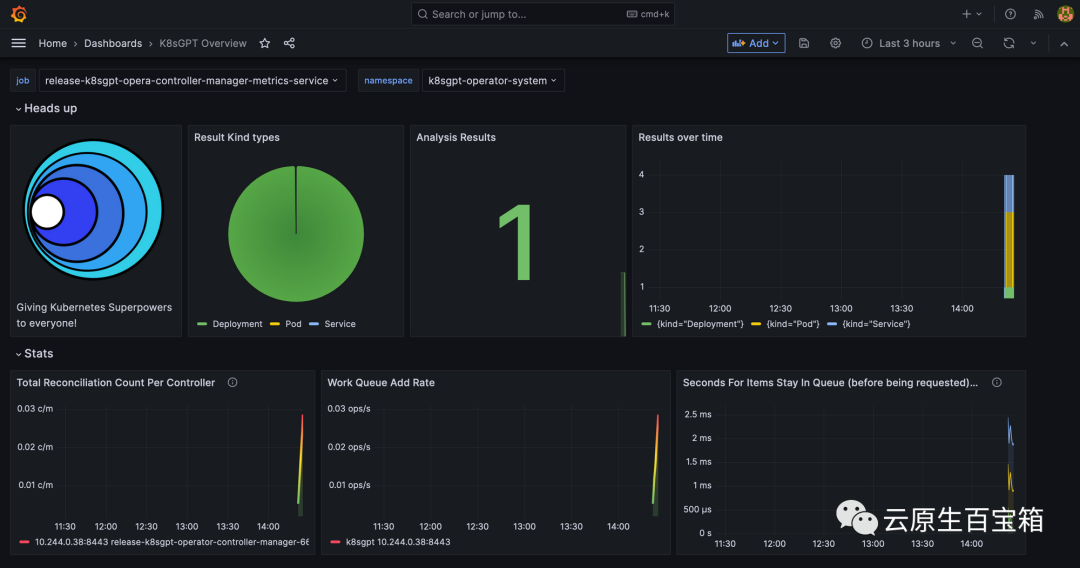

最后,我们将看一下 Grafana 仪表板。端口转发 Grafana 服务以通过 localhost 访问它:

kubectl port-forward service/prom-grafana -n prom 3000:80

打开 localhost:3000,然后导航到 Dashboards>K8sGPT Overview,然后你将看到包含结果的仪表板:

Grafana 中的 K8sGPT 仪表板

Grafana 中的 K8sGPT 仪表板

参考

- 1. https://k8sgpt.ai/

- 2. https://docs.k8sgpt.ai/

- 3. https://github.com/k8sgpt-ai

产品推荐

-

售后无忧

立即购买>- DAEMON Tools Lite 10【序列号终身授权 + 中文版 + Win】

-

¥150.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Ultra 5【序列号终身授权 + 中文版 + Win】

-

¥198.00

office旗舰店

-

售后无忧

立即购买>- DAEMON Tools Pro 8【序列号终身授权 + 中文版 + Win】

-

¥189.00

office旗舰店

-

售后无忧

立即购买>- CorelDRAW X8 简体中文【标准版 + Win】

-

¥1788.00

office旗舰店

-

正版软件

正版软件

- 波卡币是千倍币吗

- 波卡币是否具备千倍币潜力存在争议,但其基础技术和市场地位使其具有较高的增长潜力:技术优势:平行链架构、跨链互操作性、模块化设计;市场地位:跨链互操作性领先平台、高市值、机构支持;增长潜力:生态系统增长、互操作性需求、治理代币;风险和挑战:竞争激烈、技术复杂性、监管不确定性。

- 8分钟前 0

-

正版软件

正版软件

- 详解新协议ERC7683:Uniswap与 Across联合制定的跨链意图新标准

- 编译:深潮TechFlow这篇文章分为两部分。首先,我阐述了我认为链抽象基础设施对于加密货币的消费者采用至关重要,以及基于意图的架构是设计它的最佳方式。其次,我描述了意图广泛采用的主要障碍:解决方案网络的活跃度。文章最后,我提出了一个解决方案,并介绍了Across和Uniswap合作制定的标准,该标准基于CAKE工作组的反馈。这一标准旨在优化解决方案用户体验,降低进入通用解决方案网络的门槛,使大多数意图可以被路由到此网络,并最终使更大、更具竞争力的解决方案网络得以繁荣。议程问题:定义最终状态:什么使得加密

- 18分钟前 0

-

正版软件

正版软件

- 以太坊钱包地址公布

- 以太坊钱包地址是一串用于存储和接收以太币的唯一字符字符串。其特征包括:存储以太币和其他代币;发送以太坊交易;通过公钥加密,确保资金安全。

- 33分钟前 0

-

正版软件

正版软件

- ENA币价创历史新高!Ethena加码第二季空投奖励

- 稳定币协议Ethena于4月8日宣布,将进一步提高第二季空投积分活动「Sats」的奖励,只要用户将钱包中USDe总量50%以上的ENA进行锁仓,即可获得:奖励增加50%每日奖励高于所有其它池Sats积分将增加30倍ENA初期锁仓上限暂定为2亿美元,未来将进行调整以增加,锁仓ENA的冷却期为7天。交易所钱包整合通过交易所的Web3钱包锁仓USDe至少7天的用户,也能获得额外20%Sats积分提升,包括:币安BybitOKXBitget交易所Web3钱包积分提升将在北京时间4月10日晚间20:00开始。Eth

- 48分钟前 虚拟货币 区块链 比特币 稳定币 ENA币 0

-

正版软件

正版软件

- SEC盼罚Ripple20亿美元!瑞波恐抛售31亿枚XRP筹款!

- 美国证券交易委员会(SEC)于2020年12月起诉瑞波(Ripple),指控瑞波自2013年以来,就开始通过未注册的“证券”(瑞波币)募资,金额高达13亿美元。此举被认为是违法行为,瑞波也面临着高额罚款。该案在去年7月由瑞波取得初步胜利,最终审判目前预计将在今天4月23日展开。结果可能会对加密货币产业产生重大影响,根据最新的进度显示,SEC要求法官对瑞波判处2亿美元的罚款和处罚……瑞波恐出售XRP筹款根据SEC的要求,如果瑞波在法庭被判有罪且未提出上诉,将需要终审判决后30天内筹集巨额罚款。这将对于Rip

- 1小时前 11:40 虚拟货币 区块链 比特币 0